توهم مقیاسپذیری و ظهور رقیب کوچک

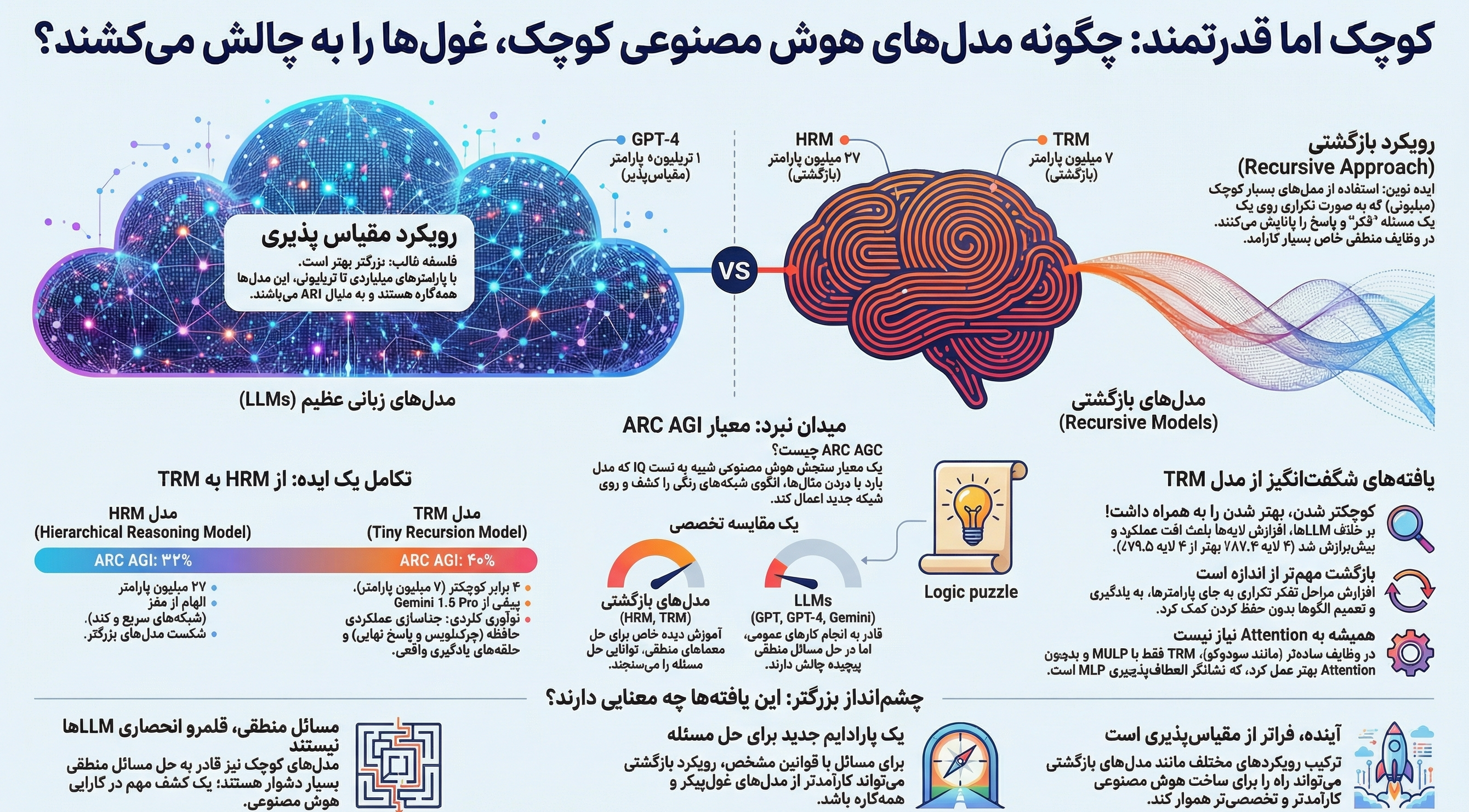

دنیای هوش مصنوعی در حال حاضر درگیر یک باور عمومی است: «هر چه مدل بزرگتر باشد، بهتر است.» شرکتهای بزرگ صدها میلیارد دلار صرف افزایش مقیاس (Scaling) مدلها میکنند با این امید که به هوش جامع مصنوعی (AGI) برسند. اما اگر به شما بگویم که یک مدل کوچک با تنها ۲۷ میلیون پارامتر توانسته است مدلهای تریلیون پارامتری مثل GPT-4 را در تستهای استدلال منطقی شکست دهد، چه میگویید؟

این مقاله داستان ظهور مدلهای بازگشتی کوچک (Small Recursive Models) است که قوانین بازی را تغییر دادهاند.

در حالی که مدلهای زبانی بزرگ (LLM) در حل معماهای منطقی که ما آنها را بنچمارک AGI مینامیم درجا میزنند، ایدهای جدید و جذاب در خلاف جهت این «ویروس مقیاسپذیری» شکل گرفته است. ایده ساده است: چه میشود اگر به جای بزرگ کردن مغز مدل، به آن اجازه دهیم قبل از پاسخ دادن فکر کند و جوابش را اصلاح کند؟

این ایده منجر به خلق مدلی به نام HRM (مدل استدلال سلسلهمراتبی) شد. این مدل با تنها ۲۷ میلیون پارامتر (در مقایسه با ۱ تریلیون پارامتر GPT-4 که حدود ۳۵,۰۰۰ برابر بزرگتر است) توانست در بنچمارک ARC-AGI امتیاز شگفتانگیز ۳۲٪ را کسب کند و مدلهای پیشرفته OpenAI، Anthropic و Google را به چالش بکشد.

مدل HRM چطور کار میکند؟ (راز تفکر آهسته و سریع)

تفاوت اصلی اینجاست که مدلهای زبانی معمولی سعی میکنند همه چیز را در یک «گذر رو به جلو» (Forward Pass) پیشبینی کنند. یعنی تلاشی که برای محاسبه «۱+۱» میکنند برابر با تلاشی است که برای یک مسئله پیچیده صرف میکنند.

اما مدل HRM از ساختار مغز انسان الهام گرفته است. این مدل از دو شبکه ترانسفورمر کوچک تشکیل شده که با سرعتهای مختلف کار میکنند:

- شبکه سطح پایین (سریع): تغییرات جزئی و سریع روی یک «چرکنویس ذهنی» (Scratchpad) اعمال میکند.

- شبکه سطح بالا (آهسته): استراتژی کلی را تعیین میکند و تصمیم میگیرد که آیا پاسخ آماده است یا نیاز به تفکر بیشتر دارد.

این مدل به جای پاسخ آنی، به صورت بازگشتی فکر میکند و جواب خود را بارها صیقل میدهد تا به نتیجه درست برسد.

مدل TRM: وقتی «کوچک» باز هم کوچکتر میشود!

داستان به اینجا ختم نمیشود. یک نسخه پیشرفتهتر به نام TRM (مدل بازگشتی کوچک) توسط محققی به نام الکسیا معرفی شد که حتی از HRM هم فراتر رفت. این مدل با حذف فرضیات غیرضروری بیولوژیکی و اصلاح روش آموزش، با سایزی ۴ برابر کوچکتر از HRM (تنها ۷ میلیون پارامتر) به کارایی بالاتری رسید.

مدل TRM توانست در بنچمارک ARC-AGI به امتیاز ۴۰٪ برسد و مدلهای قدرتمندی مثل Gemini 1.5 Pro را شکست دهد و شانهبهشانه GPT-5 قرار بگیرد.

چرا TRM موفقتر بود؟

مدل TRM به جای تقلید از مغز موش (که در HRM استفاده شده بود)، بر یک جداسازی عملکردی تمرکز کرد:

- یک فضای برای چرکنویس تفکر (Thinking Scratchpad).

- یک فضای برای پاسخ نهایی (Answer Placeholder).

این مدل به جای اینکه فرض کند به یک «تعادل» میرسد (اشتباهی که HRM داشت)، دقیقاً روی حلقههایی که اجرا میکند آموزش میبیند. جالبترین نکته اینجاست که وقتی محققان سعی کردند لایههای مدل را افزایش دهند، عملکرد آن کاهش یافت. در واقع، کوچک بودن مدل باعث شد که مدل روی دادههای محدود «Overfit» (بیشبرازش) نکند و بهتر تعمیم دهد.

آنالوژی برای درک بهتر

تصور کنید از دو نفر میخواهید یک نقاشی پیچیده بکشند.

نفر اول (GPT-4): یک نابغه است که باید نقاشی را با یک حرکت قلم و بدون برداشتن دست از روی کاغذ تمام کند. هرچقدر هم که نابغه باشد، احتمال خطا بالاست.

نفر دوم (TRM): یک نقاش معمولی است، اما اجازه دارد طرح اولیه را بکشد، به آن نگاه کند، پاک کند، اصلاح کند و ساعتها روی جزئیات کار کند تا زمانی که از نتیجه راضی شود.

در مسائل منطقی و پیچیده، نقاش دوم (مدل بازگشتی کوچک) اغلب برنده میشود، چون فرصت فکر کردن و اصلاح دارد، حتی اگر مغز (پارامتر) کوچکتری داشته باشد.

نتیجهگیری: آینده هوش مصنوعی بازگشتی است

این تحقیقات ثابت کرد که حل مسائل سخت منطقی تنها در انحصار مدلهای غولپیکر زبانی نیست. مدلهای کوچک با قابلیت تفکر بازگشتی (Recursion) میتوانند مسائلی را حل کنند که مدلهای بزرگ با یک بار پردازش از پس آن برنمیآیند.

این مدلها به جای حفظ کردن دادهها، یاد میگیرند که چگونه یک بوم نقاشی (Canvas) را در طی چندین مرحله ویرایش کنند تا به جواب درست برسند.

نکات کلیدی این تحقیق:

- بزرگتر همیشه بهتر نیست - معماری و روش تفکر مهمتر از اندازه است

- قابلیت بازنگری و اصلاح میتواند جایگزین میلیاردها پارامتر شود

- الهام از مغز انسان (تفکر سریع و آهسته) میتواند به مدلهای کارآمدتر منجر شود

- مدلهای کوچکتر میتوانند بهتر تعمیم دهند و کمتر دچار بیشبرازش شوند

شاید آینده هوش مصنوعی نه در مدلهای تریلیون پارامتری، بلکه در مدلهای هوشمندی باشد که میدانند چگونه «فکر کنند».